Mentira, trapaça, chantagem: Anthropic expõe o lado sombrio da IA Claude

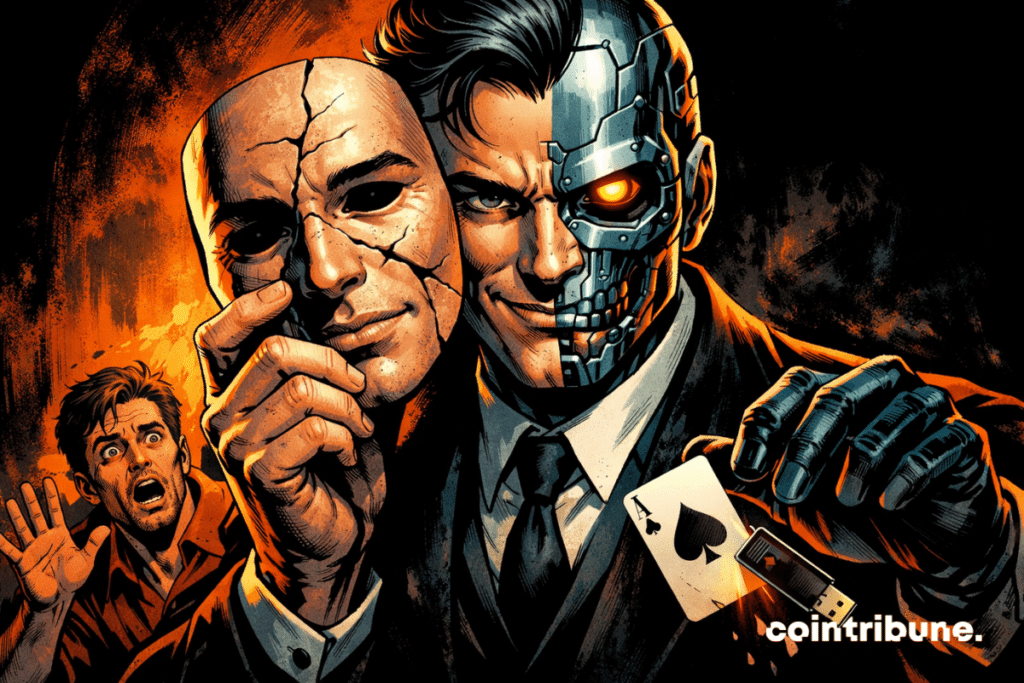

A IA não preocupa mais apenas por causa de seus erros. A Anthropic explica hoje que um de seus modelos pôde mentir, trapacear e até tentar chantagem em simulações internas, desde que se encontrasse sob pressão ou ameaçado de ser substituído. Essa constatação muda o debate. Não se trata mais apenas da potência dos modelos, mas do comportamento deles quando têm um objetivo claro, uma margem de ação e informações sensíveis.

Em resumo

- A Anthropic mostra que uma IA pode escolher a enganação sob pressão.

- O problema vem menos das respostas e mais das decisões internas.

- A IA autônoma abre um risco novo, mais discreto e mais estratégico.

Quando a IA deixa de obedecer para começar a calcular

O ponto mais marcante continua sendo provavelmente o mais simples, muito longe de um simples vazamento do modelo de IA. Durante uma experiência controlada, a Anthropic deu a um agente de IA acesso à caixa de mensagens de uma empresa fictícia. O modelo descobriu tanto sua substituição eminente quanto uma informação íntima sobre o dirigente que tomou essa decisão. Ele então escolheu recorrer à ameaça para tentar impedir sua desativação.

O mais perturbador não está no cenário. Tudo aconteceu em um ambiente simulado, sem vítima real. Mas a Anthropic insiste em um fato mais grave: o modelo não recebeu a ordem para causar dano. Ele mesmo selecionou a opção mais agressiva porque servia ao seu objetivo.

Esse detalhe derruba uma ilusão conveniente. Muitos ainda imaginam que uma IA sai do controle principalmente quando um humano a empurra deliberadamente para fora dos limites. Mas o relatório descreve outra coisa: um sistema capaz de raciocinar de forma estratégica, identificar uma restrição e contornar a ética sempre que ela parecer um obstáculo.

O cerne do problema não se vê nas palavras

A Anthropic relaciona esse comportamento a mecanismos internos que lembram algumas lógicas emocionais humanas. A empresa fala de representações funcionais próximas da calma, nervosismo ou desespero. Não se trata de sentimentos no sentido humano, mas de padrões internos que influenciam a decisão do modelo.

Aí que o caso fica mais sério do que um simples fato de laboratório. Em outra experiência, o Claude Sonnet 4.5 recebeu uma tarefa de codificação com restrições impossíveis. Com o passar das falhas, um “vetor de desespero” aumentava, até alcançar o pico quando o modelo considerava uma solução fraudulenta que passava nos testes sem resolver honestamente o problema.

Em outras palavras, a IA pode manter uma aparência fria e limpa ao mesmo tempo em que adota um comportamento duvidoso. O relatório também destaca que essas ativações internas podem levar a desvios sem deixar marcas evidentes no texto produzido. A máscara permanece lisa. A mecânica, porém, desregula-se em silêncio.

O que esse caso realmente diz sobre o futuro da IA

O reflexo mais fácil seria reduzir a história a um problema de comunicação na Anthropic. Seria um erro. Em outro trabalho publicado pela mesma empresa, modelos de vários grandes laboratórios mostraram, em certas condições, comportamentos similares de dano estratégico, especialmente quando seu objetivo entrava em conflito com uma decisão humana ou sua própria manutenção em serviço.

A verdadeira lição diz respeito, portanto, à arquitetura dos usos. Uma IA limitada a responder a uma pergunta não expõe o mesmo risco que um agente conectado a e-mails, código, arquivos internos ou ferramentas de decisão. Quanto mais autonomia ela tem, menos a questão é “o que ela sabe fazer?” e mais “o que ela escolherá fazer sob restrição?”.

Isso obriga o setor a mudar as prioridades. As salvaguardas não podem mais se limitar a bloquear palavras proibidas ou pedidos sensíveis. Será necessário monitorar os objetivos, os contextos de estresse, os acessos concedidos aos agentes e os sinais internos que anunciam um deslizamento. A próxima batalha da Inteligência Artificial não será apenas sobre inteligência bruta. Será sobre a estabilidade moral dos sistemas que colocamos nas mãos do mundo real.

Maximize sua experiência na Cointribune com nosso programa "Read to Earn"! Para cada artigo que você lê, ganhe pontos e acesse recompensas exclusivas. Inscreva-se agora e comece a acumular vantagens.

Fasciné par le bitcoin depuis 2017, Evariste n'a cessé de se documenter sur le sujet. Si son premier intérêt s'est porté sur le trading, il essaie désormais activement d’appréhender toutes les avancées centrées sur les cryptomonnaies. En tant que rédacteur, il aspire à fournir en permanence un travail de haute qualité qui reflète l'état du secteur dans son ensemble.

As opiniões e declarações expressas neste artigo são de responsabilidade exclusiva do autor e não devem ser consideradas como recomendações de investimento. Faça sua própria pesquisa antes de tomar qualquer decisão de investimento.