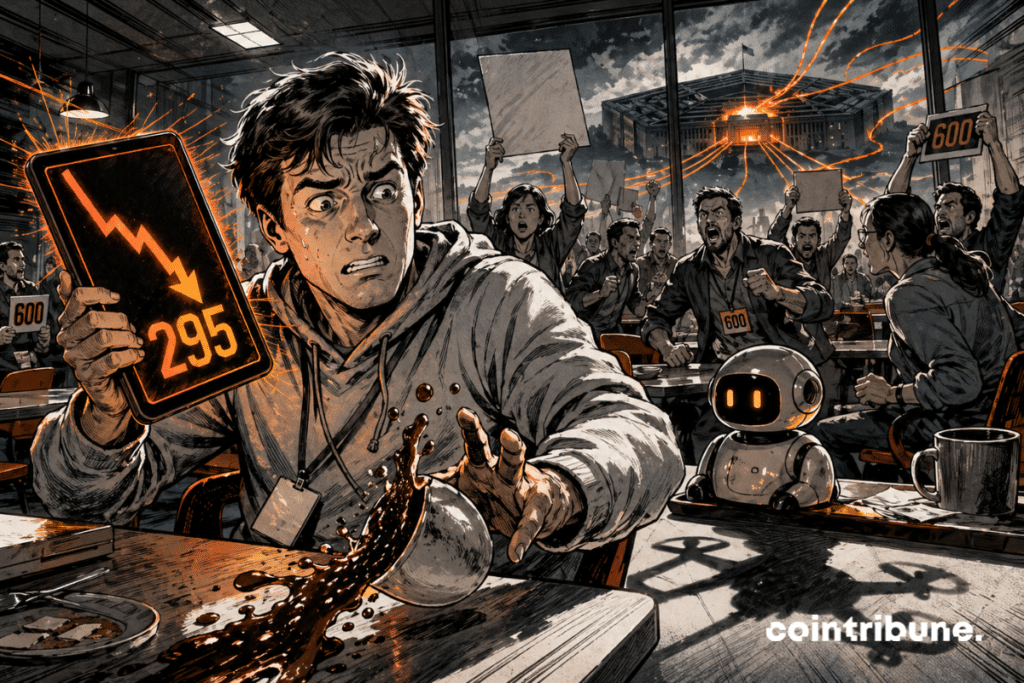

-295 % de instalaciones de ChatGPT, 600 empleados de Google en rebelión : los acuerdos IA-Pentágono siembran dudas.

Los acuerdos entre los gigantes estadounidenses de la IA y el Pentágono ya no provocan solo un debate ético. Se están convirtiendo en un asunto de confianza pública, soberanía digital e incluso competencia internacional.

En resumen

- Los acuerdos IA-Pentágono debilitan la confianza en los gigantes estadounidenses.

- Google enfrenta una rebelión interna tras la movilización de 600 empleados.

- Europa ve un argumento más para acelerar su soberanía digital.

El malestar ya no viene solo de los activistas

La crisis de confianza en torno a la IA militar estadounidense se está ampliando. Ahora afecta a usuarios, empleados tecnológicos y varios gobiernos extranjeros. La señal más visible viene de ChatGPT: en Estados Unidos, las desinstalaciones de la aplicación se dispararon un 295 % en un solo día tras el anuncio de un acuerdo entre OpenAI y el Departamento de Defensa de EE. UU., según datos de Sensor Tower citados por TechCrunch. Las descargas, por su parte, cayeron un 13 % ese mismo día.

Esta cifra no significa que ChatGPT se esté hundiendo. Dice otra cosa. Una parte del público empieza a tratar la IA como una elección política. Instalar una aplicación, mantenerla o eliminarla se convierte en una forma de votar con el teléfono.

Ese mismo reflejo aparece en Google. Más de 600 empleados pidieron a Sundar Pichai que rechazara los usos militares clasificados de la IA de la empresa. Su temor se resume en una idea simple: una vez que los modelos entran en redes secretas, escapan a la mirada pública e incluso al control interno de los equipos que los construyen.

Google reabre una vieja herida

Google ya conoce este escenario. En 2018, el Proyecto Maven provocó una rebelión interna. La empresa trabajaba entonces con el Pentágono en el análisis de imágenes de drones. La presión de los empleados terminó empujando a Google a no renovar el contrato. Esa historia sigue dentro de sus paredes.

El nuevo caso despierta, por tanto, un viejo fantasma. Según la información disponible, el acuerdo permitiría al Pentágono utilizar los modelos de Google para cualquier “finalidad gubernamental legal”. El contrato también prevé que la IA no debería usarse para vigilancia masiva interna ni para armas autónomas sin una supervisión humana adecuada. Pero el punto sensible llega justo después: Google no tendría derecho de veto sobre las decisiones operativas legales del gobierno.

Ahí es donde se instala la duda. Las garantías existen sobre el papel. Pero su alcance real sigue siendo borroso. El problema central está en esa zona gris: las empresas prometen límites, mientras el Estado conserva el control sobre el uso legal de estos sistemas. Para una tecnología tan poderosa como la IA, ese matiz pesa mucho.

Europa observa el caso con desconfianza

El debate ya supera las oficinas de Google. En Europa, estos acuerdos refuerzan una inquietud antigua: ¿se pueden confiar datos sensibles a empresas estadounidenses cuando esas mismas empresas también trabajan con el aparato de seguridad nacional de Estados Unidos?

La pregunta no es teórica. La CLOUD Act permite a las autoridades estadounidenses solicitar ciertos datos a empresas de EE. UU., incluso cuando esos datos están almacenados fuera del país. Es uno de los argumentos que empuja a varios países europeos a buscar alternativas locales. Francia ya anunció el traslado de su Health Data Hub de Microsoft Azure a Scaleway, un proveedor francés de servicios en la nube.

Pero Europa avanza con una pierna más corta que la otra. Scaleway, OVHCloud, Qwant o Ecosia muestran que existe otro camino. Sin embargo, estos actores siguen siendo diminutos frente a AWS, Google Cloud, Azure o Google Search. La soberanía digital no se decreta en un comunicado. Requiere servidores, talento, presupuestos y, sobre todo, uso diario.

La IA se convierte en una infraestructura de poder

El verdadero tema no es solo militar. Toca la naturaleza misma de la IA. Estos modelos ya no son simples asistentes para escribir un correo o resumir un documento. Se están convirtiendo en capas de infraestructura. Pueden organizar información, acelerar la toma de decisiones, ayudar a planificar operaciones y filtrar datos sensibles.

En este contexto, cada contrato con el Pentágono cambia la percepción pública. OpenAI, Google, Anthropic o xAI ya no son solo marcas de productividad. Entran en el terreno estratégico. Y cuando una empresa entra en ese terreno, las promesas de marketing dejan de bastar.

La pregunta central se vuelve brutal: ¿quién controla la IA cuando sus usos pasan a ser clasificados? ¿Los ingenieros? ¿Las empresas? ¿Los gobiernos? ¿O nadie de forma clara? Mientras esta respuesta siga siendo imprecisa, continuarán las desinstalaciones, las cartas internas y la búsqueda europea de alternativas. La duda, por su parte, no necesita un gran modelo para propagarse.

¡Maximiza tu experiencia en Cointribune con nuestro programa "Read to Earn"! Por cada artículo que leas, gana puntos y accede a recompensas exclusivas. Regístrate ahora y comienza a acumular beneficios.

Fascinado por bitcoin desde 2017, Evariste no ha dejado de investigar el tema. Si bien su interés inicial era el trading, ahora trata de comprender activamente todos los avances centrados en las criptomonedas. Como editor, se esfuerza por proporcionar constantemente un trabajo de alta calidad que refleje el estado del sector en su conjunto.

Las ideas y opiniones expresadas en este artículo pertenecen al autor y no deben tomarse como consejo de inversión. Haz tu propia investigación antes de tomar cualquier decisión de inversión.