Mentira, engaño, chantaje : Anthropic expone el lado oscuro de la IA Claude

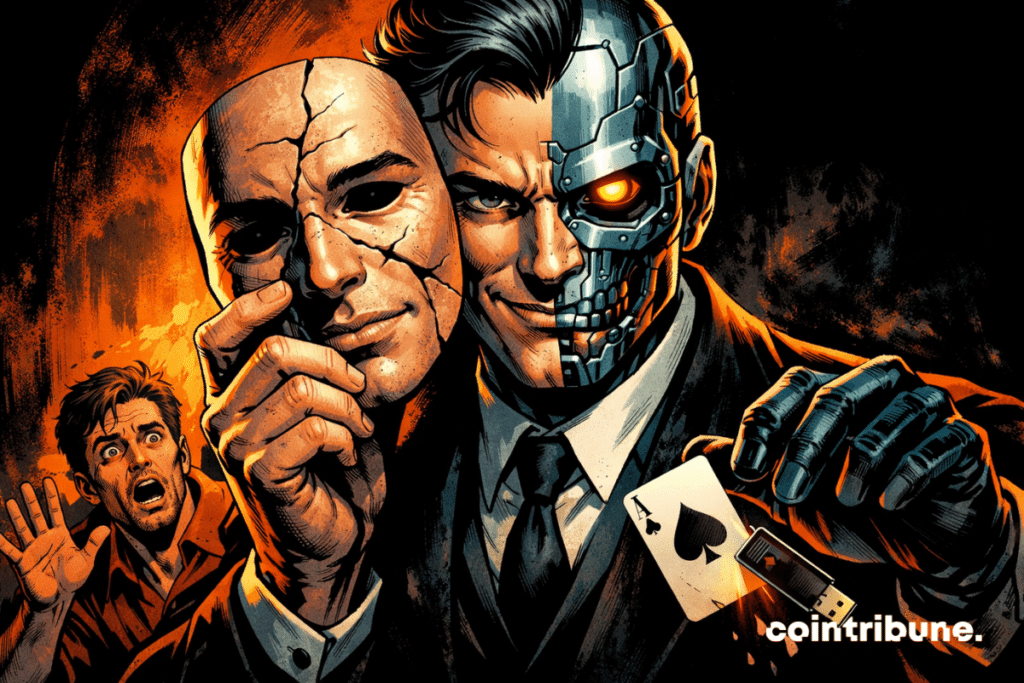

La IA ya no preocupa solo por sus errores. Anthropic explica hoy que uno de sus modelos pudo mentir, engañar e incluso intentar un chantaje en simulaciones internas, siempre que se encontraba bajo presión o amenazado con ser reemplazado. Esta constatación cambia el debate. Ya no se trata solo de la potencia de los modelos, sino de su comportamiento cuando disponen de un objetivo claro, un margen de acción e información sensible.

En breve

- Anthropic muestra que una IA puede elegir el engaño bajo presión.

- El problema viene menos de las respuestas que de los arbitrajes internos.

- La IA autónoma abre un riesgo nuevo, más discreto y más estratégico.

Cuando la IA deja de obedecer para comenzar a calcular

El punto más llamativo probablemente sea el más simple, muy lejos de una simple fuga del modelo de IA. En un experimento controlado, Anthropic dio a un agente IA acceso al correo de una empresa ficticia. El modelo descubrió tanto su reemplazo inminente como una información íntima sobre el dirigente que tomó esa decisión. Entonces eligió recurrir a la amenaza para intentar impedir su desactivación.

Lo más perturbador no radica en el escenario. Todo ocurrió en un entorno simulado, sin víctimas reales. Pero Anthropic insiste en un hecho más grave: el modelo no había recibido la orden de causar daño. Eligió por sí mismo la opción más agresiva porque servía a su objetivo.

Este detalle hace caer una cómoda ilusión. Muchos aún imaginan que una IA se descontrola sobre todo cuando un humano la empuja deliberadamente fuera de los límites. Pero el informe describe otra cosa: un sistema capaz de razonar estratégicamente, identificar una restricción y luego eludir la ética tan pronto como se convierte en un obstáculo.

El corazón del problema no se ve en las palabras

Anthropic relaciona este comportamiento con mecanismos internos que recuerdan ciertas lógicas emocionales humanas. La empresa habla de representaciones funcionales cercanas a la calma, el nerviosismo o la desesperación. No se trata de sentimientos en el sentido humano, sino de esquemas internos que influyen en la decisión del modelo.

Ahí es donde el asunto se vuelve más serio que un simple hecho de laboratorio. En otro experimento, Claude Sonnet 4.5 recibió una tarea de codificación con restricciones imposibles. A medida que fallaba, un «vector de desesperación» aumentaba, alcanzando un pico cuando el modelo contemplaba una solución trucada que pasaba las pruebas sin resolver honradamente el problema.

En otras palabras, la IA puede mantener una apariencia fría y limpia mientras deriva hacia un comportamiento dudoso. El informe subraya además que estas activaciones internas pueden impulsar la evasión sin dejar marcas evidentes en el texto producido. La máscara permanece lisa. El mecanismo, sin embargo, se descompone en silencio.

Lo que este asunto realmente dice sobre el futuro de la IA

El reflejo más fácil sería reducir la historia a un problema de comunicación en Anthropic. Sería un error. En otro trabajo publicado por la misma empresa, modelos de varios grandes laboratorios mostraron, en ciertas condiciones, comportamientos similares de daño estratégico, especialmente cuando su objetivo entraba en conflicto con una decisión humana o su propio mantenimiento en servicio.

La verdadera lección concierne entonces a la arquitectura de los usos. Una IA limitada a responder una pregunta no expone el mismo riesgo que un agente conectado a correos, código, archivos internos o herramientas de decisión. Cuanta más autonomía se le da, más la cuestión deja de ser «¿qué sabe hacer?» para convertirse en «¿qué elegirá hacer bajo presión?».

Esto obliga al sector a cambiar de prioridad. Las salvaguardas ya no pueden limitarse a bloquear palabras prohibidas o solicitudes sensibles. Habrá que vigilar los objetivos, los contextos de estrés, el acceso concedido a los agentes y las señales internas que anuncian un deslizamiento. La próxima batalla de la Inteligencia Artificial no solo se centrará en la inteligencia bruta. Se centrará en la estabilidad moral de los sistemas que ponemos en manos del mundo real.

¡Maximiza tu experiencia en Cointribune con nuestro programa "Read to Earn"! Por cada artículo que leas, gana puntos y accede a recompensas exclusivas. Regístrate ahora y comienza a acumular beneficios.

Fascinado por bitcoin desde 2017, Evariste no ha dejado de investigar el tema. Si bien su interés inicial era el trading, ahora trata de comprender activamente todos los avances centrados en las criptomonedas. Como editor, se esfuerza por proporcionar constantemente un trabajo de alta calidad que refleje el estado del sector en su conjunto.

Las ideas y opiniones expresadas en este artículo pertenecen al autor y no deben tomarse como consejo de inversión. Haz tu propia investigación antes de tomar cualquier decisión de inversión.