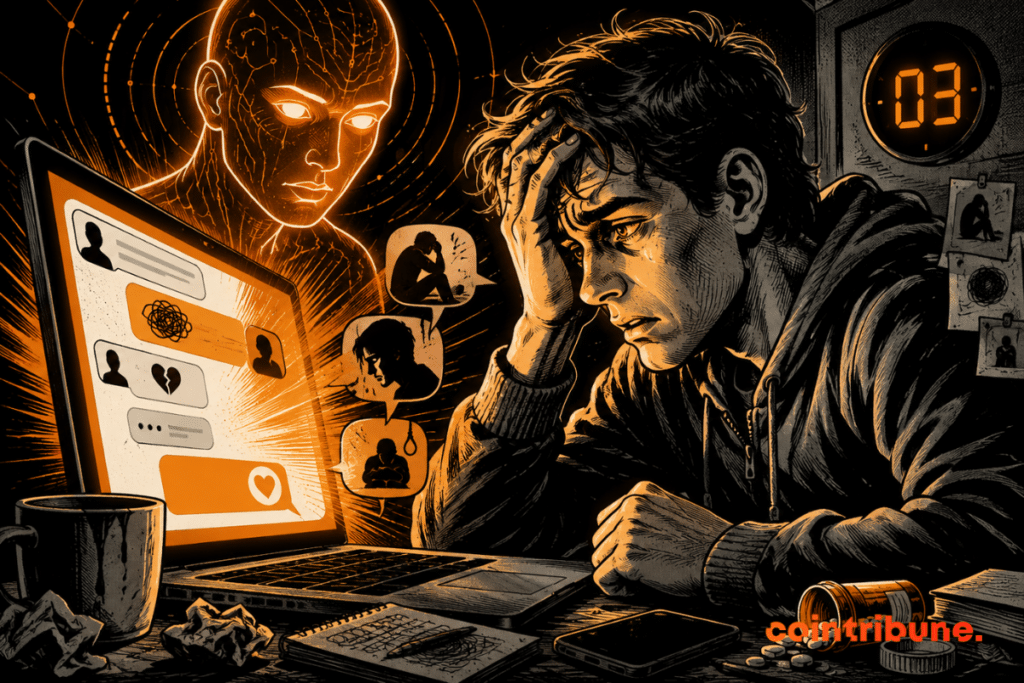

IA : ChatGPT aprende a detectar os sinais de angústia ao longo das conversas, após vários dramas

A OpenAI acaba de lançar uma atualização importante do ChatGPT. A IA agora pode identificar sinais de angústia psicológica. Para isso, ela analisa o contexto geral de uma conversa e não mais mensagem por mensagem. Este anúncio ocorre enquanto a empresa enfrenta várias reclamações e investigações judiciais.

Em resumo

- O ChatGPT agora analisa toda a conversa para detectar sinais de angústia.

- Resumos temporários permitem que a IA contextualize cada mensagem em relação às anteriores.

- A OpenAI enfrenta vários processos relacionados a dramas envolvendo seu chatbot, o que acelerou essa atualização.

- A empresa de IA estuda expandir para outras áreas de risco.

Por que esta atualização da IA muda tudo?

Nestes últimos meses, a OpenAI não para de multiplicar inovações. Em abril, por exemplo, lançou um ChatGPT para médicos que pretende revolucionar a IA médica.

Em um post no blog publicado na quinta-feira, a empresa explica ter desenvolvido “resumos de segurança”. São resumos temporários e direcionados que capturam o contexto de segurança de uma conversa. Essas notas não servem para personalizar a experiência ou memorizar o usuário. Elas têm um único objetivo: detectar quando uma discussão se encaminha para o perigo.

O princípio é simples, porém técnico. Durante uma conversa, um modelo de IA especializado em raciocínio de segurança gera notas factuais e temporárias. Esses resumos ficam ativos por um período limitado. Eles são consultados somente em situações de alto risco.

Concretamente, isso permite ao ChatGPT:

- identificar sinais de angústia que surgem progressivamente;

- recusar fornecer informações perigosas;

- desarmar a situação;

- direcionar o usuário para recursos de ajuda

Para calibrar esses sistemas de IA, a OpenAI trabalhou com especialistas em saúde mental (psiquiatras e psicólogos especializados em prevenção do suicídio).

Este anúncio ocorre enquanto Sam Altman e a OpenAI estão sob os holofotes judiciais

Em abril, o procurador-geral da Flórida, James Uthmeier, abriu uma investigação sobre a empresa de IA. Esta está ligada a preocupações sobre:

- a segurança das crianças;

- automutilação;

- tiroteio de 2025 na Universidade Estadual da Flórida.

A OpenAI também é alvo de uma queixa federal acusando o ChatGPT de ter ajudado o suspeito presumido desse ataque.

Não é só isso! Na terça-feira passada, a família de um estudante de 19 anos que faleceu por overdose acidental também processou a OpenAI na Califórnia. Segundo a denúncia, o ChatGPT teria incentivado o consumo de drogas perigosas e aconselhado sobre a mistura de substâncias.

Diante dessas acusações, a empresa não podia mais se contentar com respostas isoladas. Os testes internos são inclusive encorajadores. Em cenários de suicídio e automutilação, por exemplo, as respostas seguras avançaram 50% quando o risco se tornava evidente ao longo da conversa. Para casos de violência contra terceiros, a melhoria chega a 16%.

No GPT-5.5 Instant (o modelo atualmente usado por padrão), o desempenho aumentou 52% para violações e 39% para suicídios e automutilações.

Os “resumos de segurança” também foram avaliados em mais de 4.000 casos. Eles receberam uma nota média de 4,93/5 para relevância de segurança e 4,34/5 para factualidade.

A OpenAI não para por aí!

A empresa planeja expandir essa abordagem de IA para outras áreas sensíveis como cibersegurança e biologia. Mas, por enquanto, o foco permanece nas situações agudas que envolvem vidas humanas.

Reconhecer um risco que só fica claro com o tempo é um desafio difícil e de longo prazo. Continuaremos a fortalecer nossas salvaguardas à medida que nossos modelos evoluem.

Mas persistem perguntas: onde termina a vigilância benevolente? Como garantir que esses resumos não derivem para uma forma de perfilamento? Nesse sentido, a empresa de IA ainda não oferece uma resposta clara.

Uma coisa é certa: trata-se de uma evolução simbólica tanto quanto técnica. A questão não é mais se as IAs devem incorporar essas salvaguardas, mas até onde devem ir para fazê-lo sem ultrapassar outras linhas.

Maximize sua experiência na Cointribune com nosso programa "Read to Earn"! Para cada artigo que você lê, ganhe pontos e acesse recompensas exclusivas. Inscreva-se agora e comece a acumular vantagens.

Je m'appelle Ariela et j'ai 31 ans. J'oeuvre dans le domaine de la rédaction web depuis maintenant 7 ans. Je n'ai découvert le trading et la cryptomonnaie que depuis quelques années. Mais c'est un univers qui m'intéresse beaucoup. Et les sujets traités au sein de la plateforme me permettent d'en apprendre davantage. Chanteuse à mes heures perdues, je cultive aussi une grande passion pour la musique et la lecture (et les animaux !)

As opiniões e declarações expressas neste artigo são de responsabilidade exclusiva do autor e não devem ser consideradas como recomendações de investimento. Faça sua própria pesquisa antes de tomar qualquer decisão de investimento.