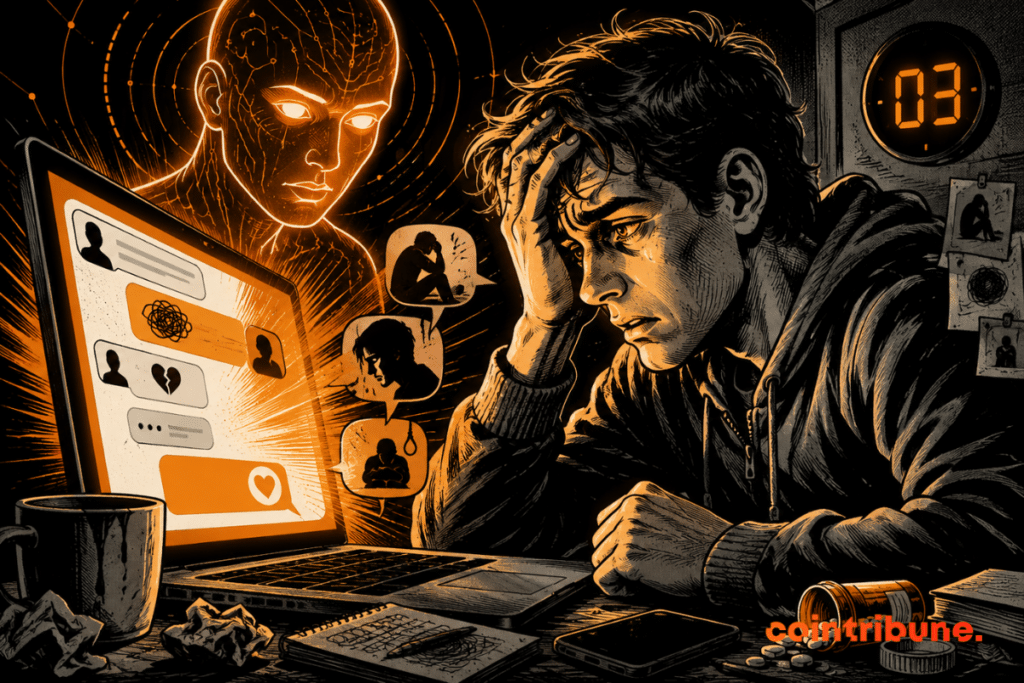

IA : ChatGPT aprende a detectar señales de angustia a lo largo de las conversaciones, tras varios dramas

OpenAI acaba de desplegar una actualización importante de ChatGPT. La IA ahora puede detectar signos de angustia psicológica. Para ello, analiza el contexto global de una conversación y no más mensaje por mensaje. Este anuncio llega mientras la empresa enfrenta varias quejas e investigaciones judiciales.

En breve

- ChatGPT ahora analiza el conjunto de una conversación para detectar señales de angustia.

- Resúmenes temporales permiten a la IA contextualizar cada mensaje con respecto a los anteriores.

- OpenAI enfrenta varios juicios relacionados con dramas que involucran a su chatbot, lo cual aceleró esta actualización.

- La empresa de IA estudia la extensión a otros ámbitos de riesgo.

¿Por qué esta actualización de IA lo cambia todo ?

En los últimos meses, OpenAI no deja de multiplicar las innovaciones. En abril, por ejemplo, lanzó un ChatGPT para médicos que pretende revolucionar la IA médica.

En una entrada de blog publicada el jueves, la empresa explica haber desarrollado “resúmenes de seguridad”. Son resúmenes temporales y dirigidos que capturan el contexto de seguridad de una conversación. Estas notas no sirven para personalizar la experiencia ni para recordar al usuario. Tienen un único objetivo: detectar cuándo una discusión deriva hacia el peligro.

El principio es simple, pero técnico. Durante una conversación, un modelo de IA especializado en razonamiento de seguridad genera notas fácticas y temporales. Estos resúmenes permanecen activos por tiempo limitado. Sólo se consultan en situaciones de alto riesgo.

Concretamente, esto permite a ChatGPT :

- detectar señales de angustia que surgen progresivamente ;

- negarse a proporcionar información peligrosa ;

- desactivar la situación ;

- redirigir al usuario hacia recursos de ayuda

Para calibrar estos sistemas de IA, OpenAI trabajó con expertos en salud mental (psiquiatras y psicólogos especializados en prevención del suicidio).

Este anuncio llega mientras Sam Altman y OpenAI están bajo el foco judicial

En abril, el fiscal general de Florida, James Uthmeier, abrió una investigación sobre la empresa de IA. Esta está vinculada a preocupaciones sobre :

- la seguridad de los niños ;

- la autolesión ;

- el tiroteo de 2025 en la Universidad Estatal de Florida.

OpenAI también enfrenta una demanda federal acusando a ChatGPT de haber ayudado al sospechoso presunto de este ataque.

¡Eso no es todo! El martes pasado, la familia de un estudiante de 19 años fallecido por una sobredosis accidental también demandó a OpenAI en California. Según la demanda, ChatGPT habría alentado el consumo de drogas peligrosas y asesorado sobre la mezcla de sustancias.

Frente a estas acusaciones, la empresa ya no podía limitarse a respuestas aisladas. Las pruebas internas son, además, alentadoras. En escenarios de suicidio y autolesión, por ejemplo, las respuestas seguras mejoraron un 50 % cuando el riesgo se volvía evidente a lo largo de la conversación. En casos de violencia hacia otros, la mejora alcanza el 16 %.

En GPT-5.5 Instant (el modelo utilizado actualmente por defecto), el rendimiento aumentó un 52 % en violencia y un 39 % en suicidios y autolesiones.

Los “resúmenes de seguridad” también se evaluaron en más de 4.000 casos. Obtuvieron una nota media de 4,93/5 en relevancia de seguridad y de 4,34/5 en factualidad.

¡OpenAI no se detiene aquí !

La empresa planea extender este enfoque de IA a otros ámbitos sensibles como la ciberseguridad y la biología. Pero por ahora, el foco está en situaciones agudas que involucran vidas humanas.

Reconocer un riesgo que sólo se clarifica con el tiempo es un desafío difícil y a largo plazo. Continuaremos reforzando nuestras protecciones a medida que evolucionen nuestros modelos.

Pero quedan preguntas: ¿dónde termina la vigilancia benevolente? ¿Cómo garantizar que estos resúmenes no deriven en una forma de perfilado? En este sentido, la empresa de IA todavía no ofrece una respuesta clara.

Una cosa está clara: se trata de una evolución tanto simbólica como técnica. La pregunta ya no es si las IA deben integrar estas protecciones, sino hasta dónde deben llegar para hacerlo sin cruzar otras líneas.

¡Maximiza tu experiencia en Cointribune con nuestro programa "Read to Earn"! Por cada artículo que leas, gana puntos y accede a recompensas exclusivas. Regístrate ahora y comienza a acumular beneficios.

Me llamo Ariela y tengo 31 años. Trabajo en el campo de la redacción web desde hace 7 años. Descubrí el trading y las criptomonedas hace solo unos años, pero es un universo que me interesa mucho. Los temas tratados en la plataforma me permiten aprender más. Cantante en mi tiempo libre, también cultivo una gran pasión por la música, la lectura (¡y los animales!)

Las ideas y opiniones expresadas en este artículo pertenecen al autor y no deben tomarse como consejo de inversión. Haz tu propia investigación antes de tomar cualquier decisión de inversión.