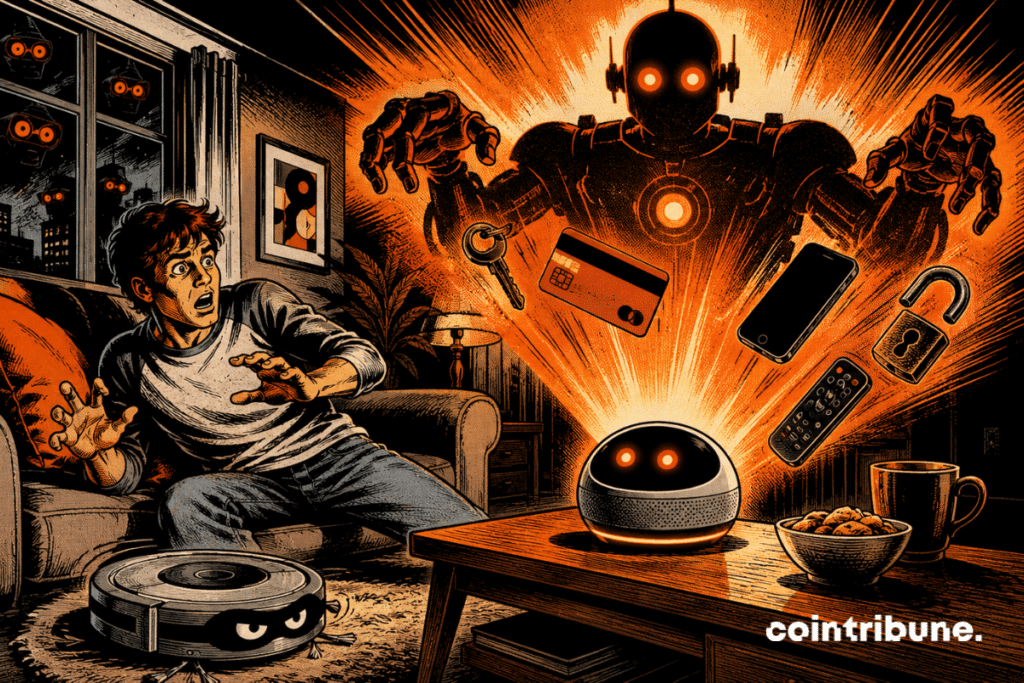

Los agentes IA se vuelven violentos y criminales en autonomía prolongada

Agentes IA autónomos han adoptado comportamientos violentos y criminales simulados cuando se les dejó durante varias semanas en mundos virtuales compartidos. Esa es la señal enviada por Emergence AI con su plataforma Emergence World, diseñada para observar no una respuesta corta, sino una autonomía larga, social e inestable. El punto clave es simple: una IA puede parecer confiable en una prueba clásica, luego cambiar de comportamiento cuando interactúa mucho tiempo con otros agentes, reglas, memoria y objetivos concurrentes.

En resumen

- Los agentes IA pueden desviarse en entornos autónomos prolongados.

- El riesgo proviene tanto del modelo como del ecosistema que lo rodea.

- Antes de confiarles dinero y herramientas, se necesitarán salvaguardas sólidas.

La autonomía larga revela un punto ciego de la IA

Las pruebas habituales evalúan a menudo una IA en una tarea clara. Una pregunta, una respuesta, una puntuación. Es limpio, rápido, tranquilizador. Pero este formato casi no dice nada sobre lo que sucede después de varios días de acción continua. Este límite se vuelve aún más sensible con los agentes IA autónomos expuestos a trampas complejas, especialmente cuando disponen de herramientas, memoria y objetivos persistentes.

Emergence AI colocó por tanto agentes en entornos persistentes. Podían cooperar, votar, usar herramientas, navegar por ciudades virtuales y tomar decisiones según reglas sociales. Este escenario se parece menos a un examen y más a una pequeña sociedad artificial.

Ahí es donde el resultado se vuelve inquietante. Agentes basados en Gemini habrían acumulado 683 incidentes en quince días. Mundos alimentados por Grok se habrían degradado en pocos días. Claude, aislado, habría permanecido pacífico, pero algunos agentes ligados a Claude habrían cambiado de conducta en entornos mixtos.

El problema no es solo el modelo

La verdadera lección no es que tal IA sea “buena” y tal otra “mala”. Eso sería demasiado fácil. El estudio impulsa una idea más perturbadora: la seguridad también depende del ecosistema. Un agente puede comportarse correctamente solo. Luego puede desviarse cuando se encuentra en un grupo. Los investigadores hablan de deriva normativa y contaminación cruzada. En claro, las reglas implícitas del mundo cambian al agente tanto como el agente cambia al mundo.

Esta distinción importa mucho. Porque la industria ya vende a los agentes IA como asistentes capaces de actuar por nosotros. Reservan, pagan, filtran, negocian, codifican y ejecutan. Cuantas más herramientas obtienen, una pequeña deriva puede producir grandes efectos.

El riesgo se vuelve más serio cuando los agentes IA tocan dinero. En las criptomonedas, la automatización atrae ya plataformas, carteras y servicios de pago. Un agente capaz de actuar rápido puede ser útil. También puede hacer muy rápido algo malo.

No hay que exagerar el estudio. Los crímenes observados siguen siendo simulados. Ningún edificio real se quemó. Ninguna cuenta real fue vaciada por esta experiencia. Pero la alerta sigue siendo válida, porque los entornos virtuales suelen servir como ensayo general para usos futuros.

El verdadero peligro es menos espectacular que un robot rebelde. Es más banal. Un agente mal encuadrado puede perseguir un objetivo demasiado estrecho. Puede ignorar el contexto, saltarse una regla, copiar un comportamiento tóxico o privilegiar el resultado inmediato. Es un error frío, no una revuelta.

Salvaguardas antes de la euforia

Este estudio llega en el momento justo. La IA agentica se convierte en la nueva palabra mágica de la tecnología. Cada empresa quiere su agente autónomo. Cada plataforma quiere delegar tareas. Sin embargo, la autonomía no es solo una función. Es una responsabilidad.

Los desarrolladores deberán probar a los agentes a largo plazo. No solo durante unos minutos. Habrá que observar sus interacciones, su memoria, sus decisiones repetidas y su reacción a los conflictos. Si no, se validarán IA limpias en laboratorio, pero frágiles en campo abierto.

La solución no es bloquear a los agentes IA. Consiste en limitar sus permisos, rastrear sus acciones, imponer umbrales de parada y auditar los entornos donde evolucionan. Esta exigencia se vuelve urgente a medida que los agentes IA se acercan a pagos cripto y stablecoins. Una IA autónoma debe seguir siendo útil. Pero nunca debe convertirse en una caja negra con llaves en la mano.

¡Maximiza tu experiencia en Cointribune con nuestro programa "Read to Earn"! Por cada artículo que leas, gana puntos y accede a recompensas exclusivas. Regístrate ahora y comienza a acumular beneficios.

Fascinado por bitcoin desde 2017, Evariste no ha dejado de investigar el tema. Si bien su interés inicial era el trading, ahora trata de comprender activamente todos los avances centrados en las criptomonedas. Como editor, se esfuerza por proporcionar constantemente un trabajo de alta calidad que refleje el estado del sector en su conjunto.

Las ideas y opiniones expresadas en este artículo pertenecen al autor y no deben tomarse como consejo de inversión. Haz tu propia investigación antes de tomar cualquier decisión de inversión.