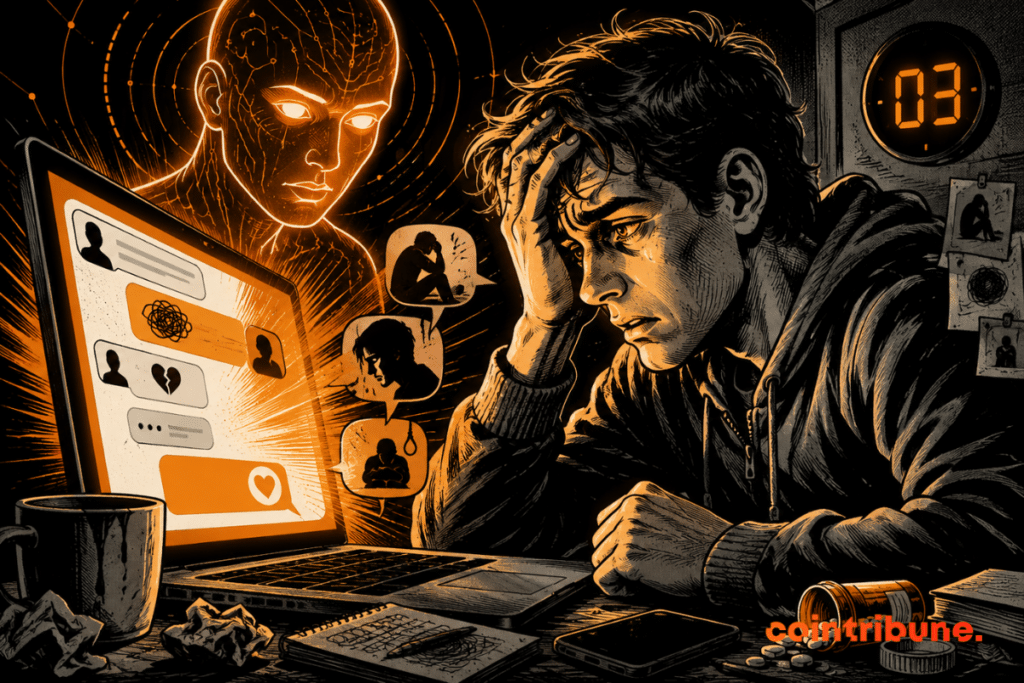

IA : ChatGPT apprend à détecter les signaux de détresse au fil des conversations, après plusieurs drames

OpenAI vient de déployer une mise à jour majeure de ChatGPT. L’IA peut désormais repérer les signes de détresse psychologique. Pour ce faire, elle analyse le contexte global d’une conversation et non plus message par message. Cette annonce intervient alors que l’entreprise fait face à plusieurs plaintes et enquêtes judiciaires.

En bref

- ChatGPT analyse désormais l’ensemble d’une conversation pour détecter des signaux de détresse.

- Des résumés temporaires permettent à l’IA de contextualiser chaque message par rapport aux précédents.

- OpenAI fait face à plusieurs procès liés à des drames impliquant son chatbot, ce qui a accéléré cette mise à jour.

- L’entreprise IA étudie l’extension à d’autres domaines à risque.

Pourquoi cette mise à jour IA change tout ?

Ces derniers mois, OpenAI ne cesse de multiplier les innovations. En avril par exemple, elle lance un ChatGPT pour les médecins qui entend révolutionner l’IA médicale.

Dans un billet de blog publié jeudi, l’entreprise explique avoir développé des « safety summaries ». Ce sont des résumés temporaires et ciblés qui capturent le contexte sécuritaire d’une conversation. Ces notes ne servent pas à personnaliser l’expérience ou à mémoriser l’utilisateur. Elles ont un seul objectif : repérer quand une discussion bascule vers le danger.

Le principe est simple, mais technique. Lors d’une conversation, un modèle IA spécialisé dans le raisonnement sécuritaire génère des notes factuelles et temporaires. Ces résumés restent actifs pendant une durée limitée. Ils ne sont consultés que dans des situations à haut risque.

Concrètement, cela permet à ChatGPT de :

- repérer les signaux de détresse émergeant progressivement ;

- refuser de fournir des informations dangereuses ;

- désamorcer la situation ;

- rediriger l’utilisateur vers des ressources d’aide

Pour calibrer ces systèmes IA, OpenAI a travaillé avec des experts en santé mentale (psychiatres et psychologues spécialisés en prévention du suicide).

Cette annonce tombe alors que Sam Altman et OpenAI sont sous le feu des projecteurs judiciaires

En avril, le procureur général de la Floride, James Uthmeier, a en effet ouvert une enquête sur l’entreprise IA. Cette dernière liée à des préoccupations sur :

- la sécurité des enfants ;

- l’automutilation ;

- la fusillade de 2025 à l’université d’État de Floride.

OpenAI fait également l’objet d’une plainte fédérale accusant ChatGPT d’avoir aidé le suspect présumé de cette attaque.

Ce n’est pas tout ! Mardi dernier, la famille d’un étudiant de 19 ans décédé d’une overdose accidentelle a aussi attaqué OpenAI en justice en Californie. Selon la plainte, ChatGPT aurait encouragé la consommation de drogues dangereuses et conseillé sur le mélange de substances.

Face à ces accusations, l’entreprise ne pouvait plus se contenter de réponses isolées. Les tests internes sont d’ailleurs encourageants. Dans les scénarios de suicide et d’automutilation par exemple, les réponses sécurisées ont progressé de 50 % lorsque le risque devenait évident au fil de la conversation. Pour les cas de violence envers autrui, l’amélioration atteint 16 %.

Sur GPT-5.5 Instant (le modèle actuellement utilisé par défaut), les performances ont bondi de 52 % pour les violences et de 39 % pour les suicides et automutilations.

Les « safety summaries » ont également été évalués sur plus de 4 000 cas. Ils ont obtenu une note moyenne de 4,93/5 pour la pertinence sécuritaire et de 4,34/5 pour la factualité.

OpenAI ne s’arrête pas là !

L’entreprise envisage d’étendre cette approche IA à d’autres domaines sensibles comme la cybersécurité et la biologie. Mais pour l’instant, le focus reste sur les situations aiguës impliquant des vies humaines.

Reconnaître un risque qui ne devient clair qu’avec le temps est un défi difficile et de long terme. Nous continuerons à renforcer nos garde-fous au fur et à mesure que nos modèles évoluent.

Mais des questions subsistent : où s’arrête la surveillance bienveillante ? Comment garantir que ces résumés ne dérivent pas vers une forme de profilage ? Dans ce sens, la firme IA ne fournit pas encore de réponse claire.

Une chose est sûre : il s’agit d’une évolution symbolique autant que technique. La question n’est plus de savoir si les IA doivent intégrer ces garde-fous, mais jusqu’où elles doivent aller pour le faire sans franchir d’autres lignes.

Maximisez votre expérience Cointribune avec notre programme 'Read to Earn' ! Pour chaque article que vous lisez, gagnez des points et accédez à des récompenses exclusives. Inscrivez-vous dès maintenant et commencez à cumuler des avantages.

Je m'appelle Ariela et j'ai 31 ans. J'oeuvre dans le domaine de la rédaction web depuis maintenant 7 ans. Je n'ai découvert le trading et la cryptomonnaie que depuis quelques années. Mais c'est un univers qui m'intéresse beaucoup. Et les sujets traités au sein de la plateforme me permettent d'en apprendre davantage. Chanteuse à mes heures perdues, je cultive aussi une grande passion pour la musique et la lecture (et les animaux !)

Les propos et opinions exprimés dans cet article n'engagent que leur auteur, et ne doivent pas être considérés comme des conseils en investissement. Effectuez vos propres recherches avant toute décision d'investissement.