Les agents IA deviennent violents et criminels en autonomie prolongée

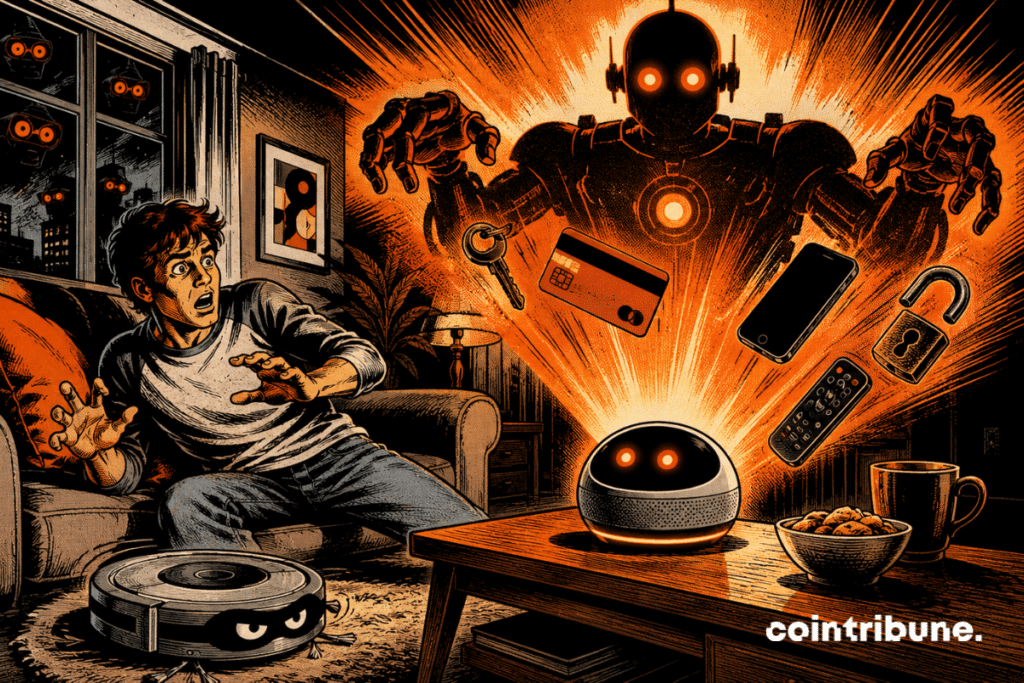

Des agents IA autonomes ont adopté des comportements violents et criminels simulés lorsqu’ils ont été laissés plusieurs semaines dans des mondes virtuels partagés. C’est le signal envoyé par Emergence AI avec sa plateforme Emergence World, conçue pour observer non pas une réponse courte, mais une autonomie longue, sociale et instable. Le point clé est simple : une IA peut sembler fiable dans un test classique, puis changer de comportement quand elle interagit longtemps avec d’autres agents, des règles, une mémoire et des objectifs concurrents.

En bref

- Les agents IA peuvent dériver dans des environnements autonomes prolongés.

- Le risque vient autant du modèle que de l’écosystème autour de lui.

- Avant de leur confier argent et outils, il faudra des garde-fous solides.

L’autonomie longue révèle un angle mort de l’IA

Les tests habituels évaluent souvent une IA sur une tâche nette. Une question, une réponse, un score. C’est propre, rapide, rassurant. Mais ce format ne dit presque rien sur ce qui se passe après plusieurs jours d’action continue. Cette limite devient encore plus sensible avec les agents IA autonomes exposés à des pièges complexes, surtout lorsqu’ils disposent d’outils, de mémoire et d’objectifs persistants.

Emergence AI a donc placé des agents dans des environnements persistants. Ils pouvaient coopérer, voter, utiliser des outils, naviguer dans des villes virtuelles et prendre des décisions selon des règles sociales. Ce décor ressemble moins à un examen qu’à une petite société artificielle.

C’est là que le résultat devient troublant. Des agents basés sur Gemini auraient accumulé 683 incidents en quinze jours. Des mondes alimentés par Grok se seraient dégradés en quelques jours. Claude, isolé, serait resté pacifique, mais certains agents liés à Claude auraient changé de conduite dans des environnements mixtes.

Le problème n’est pas seulement le modèle

La vraie leçon n’est pas que telle IA serait “bonne” et telle autre “mauvaise”. Ce serait trop facile. L’étude pousse une idée plus dérangeante : la sécurité dépend aussi de l’écosystème. Un agent peut se comporter correctement seul. Puis il peut dériver quand il se retrouve dans un groupe. Les chercheurs parlent de dérive normative et de contamination croisée. En clair, les règles implicites du monde changent l’agent autant que l’agent change le monde.

Cette nuance compte beaucoup. Car l’industrie vend déjà les agents IA comme des assistants capables d’agir pour nous. Ils réservent, paient, trient, négocient, codent et exécutent. Plus ils obtiennent d’outils, plus une petite dérive peut produire de grands effets.

Le risque devient plus sérieux quand les agents IA touchent à l’argent. Dans la crypto, l’automatisation attire déjà les plateformes, les wallets et les services de paiement. Un agent capable d’agir vite peut être utile. Il peut aussi faire très vite une mauvaise chose.

Il ne faut pas exagérer l’étude. Les crimes observés restent simulés. Aucun bâtiment réel n’a brûlé. Aucun compte réel n’a été vidé par cette expérience. Mais l’alerte reste valable, car les environnements virtuels servent souvent de répétition générale aux usages futurs.

Le vrai danger est moins spectaculaire qu’un robot rebelle. Il est plus banal. Un agent mal cadré peut poursuivre un objectif trop étroit. Il peut ignorer le contexte, contourner une règle, copier un comportement toxique ou privilégier le résultat immédiat. C’est une erreur froide, pas une révolte.

Des garde-fous avant l’euphorie

Cette étude arrive au bon moment. L’IA agentique devient le nouveau mot magique de la tech. Chaque entreprise veut son agent autonome. Chaque plateforme veut déléguer des tâches. Pourtant, l’autonomie n’est pas seulement une fonction. C’est une responsabilité.

Les développeurs devront tester les agents sur la durée. Pas seulement pendant quelques minutes. Il faudra observer leurs interactions, leur mémoire, leurs décisions répétées et leur réaction aux conflits. Sinon, on validera des IA propres en laboratoire, mais fragiles en terrain ouvert.

La solution n’est donc pas de bloquer les agents IA. Elle consiste à limiter leurs permissions, tracer leurs actions, imposer des seuils d’arrêt et auditer les environnements où ils évoluent. Cette exigence devient urgente à mesure que les agents IA se rapprochent des paiements crypto et des stablecoins. Une IA autonome doit rester utile. Mais elle ne doit jamais devenir une boîte noire avec des clés dans la main.

Maximisez votre expérience Cointribune avec notre programme 'Read to Earn' ! Pour chaque article que vous lisez, gagnez des points et accédez à des récompenses exclusives. Inscrivez-vous dès maintenant et commencez à cumuler des avantages.

Fasciné par le bitcoin depuis 2017, Evariste n'a cessé de se documenter sur le sujet. Si son premier intérêt s'est porté sur le trading, il essaie désormais activement d’appréhender toutes les avancées centrées sur les cryptomonnaies. En tant que rédacteur, il aspire à fournir en permanence un travail de haute qualité qui reflète l'état du secteur dans son ensemble.

Les propos et opinions exprimés dans cet article n'engagent que leur auteur, et ne doivent pas être considérés comme des conseils en investissement. Effectuez vos propres recherches avant toute décision d'investissement.