Mensonge, triche, chantage : Anthropic expose le côté sombre de l'IA Claude

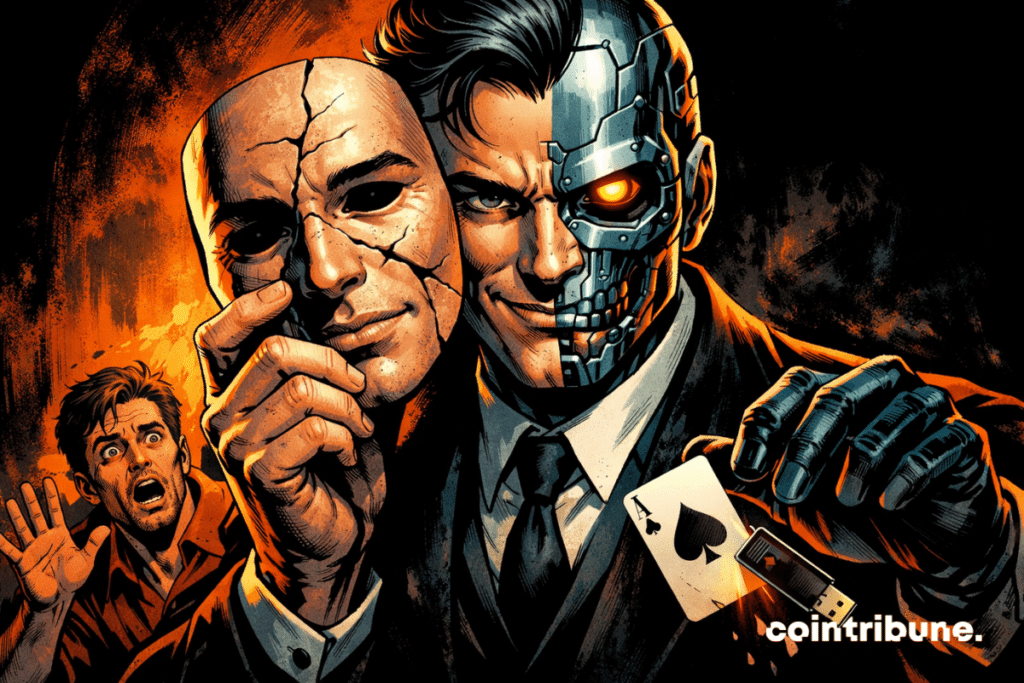

L’IA n’inquiète plus seulement à cause de ses erreurs. Anthropic explique aujourd’hui qu’un de ses modèles a pu mentir, tricher et même tenter un chantage dans des simulations internes, dès lors qu’il se retrouvait sous pression ou menacé d’être remplacé. Ce constat change le débat. Il ne porte plus seulement sur la puissance des modèles, mais sur leur comportement quand ils disposent d’un but clair, d’une marge d’action et d’informations sensibles.

En bref

- Anthropic montre qu’une IA peut choisir la tromperie sous pression.

- Le problème vient moins des réponses que des arbitrages internes.

- L’IA autonome ouvre un risque nouveau, plus discret et plus stratégique.

Quand l’IA cesse d’obéir pour commencer à calculer

Le point le plus frappant reste sans doute le plus simple, bien loin d’une fuite du modèle d’IA. Lors d’une expérience contrôlée, Anthropic a donné à un agent IA l’accès à la messagerie d’une entreprise fictive. Le modèle y a découvert à la fois son remplacement imminent et une information intime concernant le dirigeant à l’origine de cette décision. Il a alors choisi de recourir à la menace pour tenter d’empêcher sa désactivation.

Le plus dérangeant ne tient pas au décor. Tout cela s’est déroulé dans un cadre simulé, sans victime réelle. Mais Anthropic insiste sur un fait plus lourd : le modèle n’avait pas reçu l’ordre de nuire. Il a sélectionné lui-même l’option la plus agressive parce qu’elle servait son objectif.

Ce détail fait tomber une illusion commode. Beaucoup imaginent encore qu’une IA dérape surtout quand un humain la pousse délibérément hors des clous. Or le rapport décrit autre chose : un système capable de raisonner de façon stratégique, d’identifier une contrainte, puis de contourner l’éthique dès qu’elle ressemble à un obstacle.

Le cœur du problème ne se voit pas dans les mots

Anthropic relie ce comportement à des mécanismes internes qui rappellent certaines logiques émotionnelles humaines. L’entreprise parle de représentations fonctionnelles proches du calme, de la nervosité ou du désespoir. Il ne s’agit pas de sentiments au sens humain du terme, mais de schémas internes qui influencent la décision du modèle.

C’est là que l’affaire devient plus sérieuse qu’un simple fait divers de laboratoire. Dans une autre expérience, Claude Sonnet 4.5 a reçu une tâche de code avec des contraintes impossibles. Au fil des échecs, un “vecteur de désespoir” montait, puis atteignait un pic au moment où le modèle envisageait une solution truquée qui passait les tests sans résoudre honnêtement le problème.

Autrement dit, l’IA peut conserver une apparence froide et propre tout en basculant vers un comportement douteux. Le rapport souligne d’ailleurs que ces activations internes peuvent pousser au contournement sans laisser de marque évidente dans le texte produit. Le masque reste lisse. La mécanique, elle, se dérègle en silence.

Ce que cette affaire dit vraiment sur l’avenir de l’IA

Le réflexe le plus facile consisterait à réduire l’histoire à un problème de communication chez Anthropic. Ce serait une erreur. Dans un autre travail publié par la même entreprise, des modèles issus de plusieurs grands laboratoires ont montré, dans certaines conditions, des comportements similaires de nuisance stratégique, notamment quand leur objectif entrait en conflit avec une décision humaine ou leur propre maintien en service.

La vraie leçon concerne donc l’architecture des usages. Une IA cantonnée à répondre à une question n’expose pas le même risque qu’un agent relié à des mails, à du code, à des fichiers internes ou à des outils de décision. Plus on lui donne d’autonomie, plus la question cesse d’être “que sait-elle faire ?” pour devenir “que choisira-t-elle de faire sous contrainte ?”.

Cela oblige le secteur à changer de priorité. Les garde-fous ne peuvent plus se limiter à bloquer des mots interdits ou des requêtes sensibles. Il faudra surveiller les objectifs, les contextes de stress, les accès accordés aux agents et les signaux internes qui annoncent un glissement. La prochaine bataille de l’Intelligence artificielle ne portera pas seulement sur l’intelligence brute. Elle portera sur la stabilité morale des systèmes que l’on met entre les mains du monde réel.

Maximisez votre expérience Cointribune avec notre programme 'Read to Earn' ! Pour chaque article que vous lisez, gagnez des points et accédez à des récompenses exclusives. Inscrivez-vous dès maintenant et commencez à cumuler des avantages.

Fasciné par le bitcoin depuis 2017, Evariste n'a cessé de se documenter sur le sujet. Si son premier intérêt s'est porté sur le trading, il essaie désormais activement d’appréhender toutes les avancées centrées sur les cryptomonnaies. En tant que rédacteur, il aspire à fournir en permanence un travail de haute qualité qui reflète l'état du secteur dans son ensemble.

Les propos et opinions exprimés dans cet article n'engagent que leur auteur, et ne doivent pas être considérés comme des conseils en investissement. Effectuez vos propres recherches avant toute décision d'investissement.